Dr. Antal Péter

Emberközpontú mesterséges intelligencia a gondolkodás iskolájában

Jó napot kívánok! Köszönöm a meghívást és a lehetőséget. Elsőként egy beismerés, hogy magam elsősorban mesterséges intelligencia kutatóként beszélnék, amire egyik mentségem az, hogy harminc évvel ezelőtt egy TDK keretében gondolhattam át azt, hogy az emberi gondolkodást hogyan lehet segíteni MI eszközökkel, és egy nagyon szép perspektívát kínál, hogy mekkorát változott a mesterséges intelligencia. Tehát elsőként az emberközpontú mesterséges intelligenciának a különböző értelmezéseit szeretném összefoglalni, megemlítve egy M.Sc. programot, ami a BME VIK karán fut. Majd speciális technikákat villantanék fel, lehetséges MI szerepeket, emberközpontú, mesterséges intelligenciához illő szerepeket, és végül az etikai aspektust tárgyalnám.

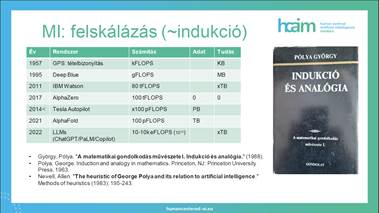

Az emberközpontú MI (eMI) projekt egy biztos hátteret adott ahhoz, hogy hogyan is lehet fölhasználni a társadalom számára az eMI-t. Korábban a mesterséges intelligencia kutatások szinte kizárólag az egyéni gondolkodásra irányultak, azaz az emberi gondolkodás törvényszerűségeire évezredeken keresztül. Tehát a régi görögöktől, a szillogizmusokon keresztül a középkoron át, ezeknek a csiszolásán keresztül jelen volt az emberi gondolkodásról való gondolkodás, de nem volt jelen a mostani társadalmi lépték. Tehát ami itt egy nagyon nagy változás, hogy a mostani MI eszközök társadalmi léptékben kerülnek felhasználásra, és kérdés az, hogy hogyan lehet ezeket a teljes életciklusukban figyelemmel kísérni, etikusan létrehozni és támogatni. A következő ábrán látszik ez a felskálázás, hogy mennyire nagy a léptékváltás, hogy hogyan is történt a mesterséges intelligenciának akár az egy-két évtizeddel ezelőtti, úgymond elefántcsonttoronybeli állapotának a megváltozása. Tehát, amiket itt látunk, azok rendszerek. Ugyebár '57-ben ez a GPS, ez a General Program Solver nevű rendszer volt, amely csupán pár ezer bájtnyi és ezres nagyságrendű lépésszámú megoldóképességgel bírt, de már akkor egy általános problémamegoldó eszközként volt aposztrofálva.

A pár évszázados matematikai-logikai fejlődés itt lett beváltva elsőként az MI-ben egyfajta tételbizonyítási keretben. Utána jöttek további eszközök, mint például a sakkozó számítógép, az IBM Watson, amely egyszerűen léptéket váltott a számítási kapacitás fejlődésével. Majd megjelentek például az önvezető autóval kapcsolatos rendszerek, majd például egy nagyon híres biológiai problémát, a fehérjéknek a térszerkezetét fantasztikus teljesítménynyel megjósló rendszerek, amelyek azt mutatták, hogy praktikusan erről a pár ezer bájtnyi, tehát pár oldalnyi instrukcióból, amit itt láthatunk is, például Pólya Györgynek, hogyan gondolkozik egy matematikus művéből, és azt hogyan lehet egy tételbizonyításban felhasználni, tehát ettől a ponttól hogyan érte el azt a határt, hogy minden írott tudást, ami elérhető, praktikusan be tudunk gyömöszölni egy gépbe.

Az IBM Watson-ja nagyjából tíz évvel ezelőtt volt képes erre, illetve a mostani öntanuló rendszerek pedig ezeket kicsit más formában képesek egy belső reprezentációvá átgyúrni. Tehát ez a hatalmas skálázódás és a társadalmi lépték, ami új. És ezek a veszélyek már mások, mint az egyéni szintűek. Például vannak a személyes szintű adatbázisaink, amelyek lehet, hogy eleve hordoznak egy elfogultságot. Viszont ezek az új rendszerek lehetséges, hogy kialakítanak egy digitális addikciót. Bár nagyon sok rendszernél felmerül az a vád, hogy a rendszernek, mondjuk egy ajánló rendszernek, ami videókat ajánl, könnyebb szinte megváltoztatni a felhasználót és függést kialakítani, mint valójában jó ajánlásokat létrehozni. Tehát kialakít egy digitális addikciót, amelyről tudjuk, hogy bár az addikció az igazából ezerarcú, de a mélyben a megerősítéses tanulásos vonal ugyanaz.

További másik a társadalmi szintű MI hatás például a propagandáknak a jelenléte vagy a munkaerőpiaci hatások, vagy az, hogyan lehet egy olyan kamerahálózatot létrehozni, ahol valós időben zajlik egy folyamatos állampolgári megfigyelés és pontozás, amelyre létező példa Kína. Tehát itt olyan rendszereket lehet nagyon könnyen létrehozni, amelyről 50–60 évvel ezelőtt az írók rémképeket festettek, helyesen. Egy nagyon meglepő eredmény volt, hogy a gyógyszerkutatásban használt mesterséges intelligencia módszereket, hogyha arra használják, hogy toxinokat, tehát veszélyes kémiai vegyületeket állítsanak elő, akkor sokkal hatékonyabbak, mint magában a gyógyszerkutatásban. Tehát sokkal könnyebb egy rosszindulatú felhasználást létrehozni, mint akár egy jóindulatút. Illetve megjelentek azok az aggodalmak is, amelyek akár az emberi fajnak, vagy akár a teljes ökoszisztémának a veszélyeztetettségét helyezik a központba, ahol potenciálisan el tudunk képzelni egy olyan helyzetet, ahol a masszív félreértés, a társadalmi szintű függés olyan mértékű, hogy egy olyan infrastruktúrává válik, mint mondjuk a villamosenergia-hálózat, amit egy napkitörés sajnos el tud söpörni.

A mesterséges intelligencia talán egy kisebb támadás, egy rosszindulatú támadás esetén még sérülékenyebb is. Tehát ezek mind-mind veszélyek, amelyekre az EU próbált megoldást találni, tehát 2018-tól indult el az AI Act-nek a kidolgozása, amelyet 2023 júniusában, tehát most júniusban fogadta el az Európa Parlament ezt az átfogó szabályozást, amelyik megköveteli a teljes életciklusban és társadalmi hatásban történő gondolkodást.

Hogyan lehet egy-egy terméknél felmérni a kockázatokat, a társadalmi szintű következményeket, és ezeket végigvinni felelősséggel. Erről egy konferenciát is rendeztünk a BME-én. De ez nemcsak az EU-ban, hanem az USA-ban, igazából Brazíliában, Nagy-Britanniában is fontos társadalmi feladat, így egymást követik ezek a szabályozások, amelyek mind ezt a léptékváltást próbálják meg valahogy kordában tartani. Tehát, hogy melyek azok az eMI termékek, amelyek tiltottak, mint például az előbb említett valós idejű megfigyelés, az állampolgári pontozás, az adatbázisok korlátlan összekapcsolása, illetve melyek azok, amelyek nagy figyelmet, auditot, folyamatos log-olást igényelnek, és melyek azok, amelyek esetleg szabadon, veszély nélkül fejleszthetőek.

Milyen értelmezései is vannak a mesterséges intelligenciának? Mi is lehet ez az emberközpontú mesterséges intelligencia?

Az egyik, az a hosszú távú problematika, mondhatni, hogy hogyan lehet hosszú távon összehangolni az értékeinket. Hogyan lehet az emberi értékeket, akár társadalmi szintű célokat helyesen megfogalmazni. Tehát mondjuk a közvetlen védelem egy ilyen lehetőség volna, ahol hogyan tudunk egy mesterséges intelligenciától olyan tanácsokat kérni, ahol a mellékhatások tényleg nem lesznek veszélyesebbek, mint mondjuk az elérni kívánt cél.

Amit ez a projekt – a Human-Centered AI Masters M.Sc. program – fölvállalt, az maga a jogszabályi követés. Tehát az, hogy hogyan lehet az alapvető emberi jogokat betartó mesterséges intelligencia fejlesztéseket véghezvinni. Hogyan lehet például a felelősség kérdését kezelni? Ez nehéz kérdésnek tűnhet, hiszen ugyebár egy szoftverrendszernél is az első, amit az ember lát, hogy semmiért nem vállalnak felelősséget. Ekkor viszont hogyan lehet azt kijelenteni, hogy egy tinédzsernél nem alakul ki egy olyan testképzavar, mondjuk egy közösségi platform használatával, ami utána egy életen keresztül megnyomorítja.

Az eMI-nek egy másik értelmezése az interakcióra helyezi a hangsúlyt, hogyan lehet hatékony emberi kommunikációt létrehozni. Itt a paletta nagyon széles, tehát az egyszerű, hatékony kommunikációt, amit a ChatGPT-től látunk, akár hogyan lehet a viselhető elektronikai eszközöket, vagy akár a kiterjesztett valóság szemüveges világot kézben tartani. A tantervből csak annyit emelnék ki, hogy ami igazából új, az az, hogy a mesterséges intelligenciának az etikája, a mesterséges intelligencia és a jog, és egy mesterséges általános intelligencia nevű tárgy kerül a portfólióba. Aki ezeket teljesíti, azok egy igazolást kapnak ennek az M.Sc.-nek az elvégzéséről.

Az eMI új technológiái

Amellett, hogy hogyan lehet kifejezni az emberi preferenciákat. Az emberi tudásnak a modellezésén túl manapság egyre nagyobb hangsúlyt kapnak a preferenciáknak a tanulásai. Tehát hogyan lehet egy bizonytalanságot fenntartani a gépen belül, hogy a felhasználónak a kívánságait, azt kellő bizonytalansággal szemléljük. Ennek van matematikája.

Egy másik nagyon érdekes matematika, amelyik az úgynevezett adatvédettséget megőrző tanulás. Hogyan tehetjük azt meg, hogy valaki megőrzi az adatát, elmond róla statisztikákat, és ezeket a statisztikákat kombinálva mégis egy globális modellt tudunk tanulni. Erre szintén vannak megoldások. Nem feltétlenül kriptográfiaiak, hanem akár csak statisztikai elvűek.

Az oksági következtetés. Megszoktuk, hogy a gép az jól asszociál, de manapság ezen túl lehet menni, és az a fajta hipotetikus érvelés, hogy mi lett volna, ha egy másik cselekedetet választunk, azt is képes kezelni. Ilyen hipotetikus szcenárióban is tudnak a gépek egyre inkább érvelni, még ha ez nincs is bent még a mostani nyelvi rendszerekben. Végül pedig a transzformerek világa, tehát ezek a nagy nyelvi modellek, ezek már mindent megesznek, mármint nemcsak szöveget, hanem például képi információt is. Képesek létrehozni egy olyan tudásreprezentációs réteget, ami általános, és erre rá lehet építeni speciális, úgynevezett szűk mesterséges intelligenciákat. Ez nem új, mindig is nagyon sokan szerették volna ezt a fajta univerzális réteget, ezt a mesterséges általános intelligenciát, akár statikusan, akár csak dinamikusan. De most úgy tűnik, hogy sikerült egy ilyet elérni.

Milyen szerepeket vállalhat fel ez az emberközpontú mesterséges intelligencia? Jómagam 30 éve még a LOGO világában, tehát a piaget-i gondolkodás, a programozás oktatása, az algoritmikus gondolkodás segítésének korszakában gondoltam át az MI felhasználását a gyermeki gondolkodás fejlesztésében. Illetve már akkor is jelen voltak a mindenfajta, de főként az elektromos, digitális hálózatoknak a szimulációi, ami aztán elszabadult, és mindent szimuláltunk. De itt egyszerűen megjelent az, hogy például a programozást egy személyre szabott asszisztens végzi.

A szimulációkat amellett, hogy az eMI teljesen valósághűvé tudja tenni ezt, úgymond fizikokémiai szinten is akár, amellett meg is tudja magyarázni az ismeretszerzés kapcsán. Ugyebár megszoktuk, hogy a Google szinte diktálja, hogy mit olvassunk el. És ugyebár az ember azt gondolja, hogy azért a diáknak a segítése, hogy egy adott problémában milyen más problémákat érdemes megfontolni, ez egy nagyon nehéz kérdés. Itt azért a mesterséges intelligencia sem triviális, hogy tud-e segíteni, de itt végül is Pólya Györgynek az analógia ötlete megvalósult 60 év után! Ami azt demonstrálja, hogy a matematikai kreativitást is képesek ezek a látens reprezentációk megragadni. Tehát van arra lehetőség, hogy akár a diák-diák kapcsolatot létrehozni, vagy egy feladat-feladat hasonlóságot ezek a látványos reprezentációk és a mesterséges általános intelligencia képesek megragadni.

Professzionális matematikusoknak is nem úgy segít egy tételbizonyításban a gép, hogy itt az axiómarendszer és úgymond a deduktív következtetési lépéseket ledarálja, hanem ő maga veszi észre a mintázatokat, érdekes mintázatokat, és akár maga próbálja bizonyítani, vagy pedig egy matematikus segítségével próbálja ezeket filtrálni.

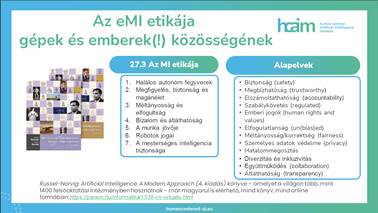

Utolsó gondolat, hogy mi van ezen túl? Amellett tehát, hogy ezek a modern mesterséges általános intelligencia rendszerek tudnák segíteni akár egy biológus gondolkodását, tudnák segíteni egy szimulációnak a használatát, tudnák az ismeretszerzést segíteni, vagy akár azt is, hogy problémák között hasonlókat találjunk, azt is tudják segíteni, hogy az eMI számára előírt elvárásainkat egymás közötti kapcsolatainkban is tudatosítsák. Egy nagyon híres könyvnek egy eMI etikája fejezetéből valók, pontosabban alfejezetéből, és ezeken az alapelveken gyorsan végigmennék.

Tehát azok az elvek, hogy az eMI megoldásoknak biztonságosnak kell lenni, megbízhatónak kell lenni, elszámoltathatónak kell lenni akár a fejlesztőinek, az adatbázisgazdának stb.-nek, szabálykövetőnek kell lenni. A jogi szabály, tehát az eMI szabályozásának a követését meg kell követelnünk.

Emberi jogok tiszteletben tartása, elfogulatlanság, méltányosság. Ezek olyan alapelvek, amelyeket szinte indirekten arra lehet használni, hogyha az eMI-nek be kell tartani egy ember számítógép kommunikációban, akkor az ember számára is fontos elvárások. Tehát szerintem valahogy ez át fog szivárogni, és akár a diákság számára is fontos tanulság lesz az, hogy ezt elvárjuk a géptől, de elvárjuk egymástól is. Az ember-ember együttműködésben.

Itt említem meg, hogy ennek a könyvnek a negyedik kiadását is a mi MI csoportunk fordította le, de talán ez volt az utolsó, mivel most már a gép fogja helyettünk végezni valószínűleg.

Köszönöm a figyelmüket!